La IA Agéntica está evolucionando rápidamente y, aunque estos sistemas aún no son perfectos, su adopción temprana con los controles de riesgo adecuados garantiza que las empresas se mantengan a la vanguardia y maximicen los beneficios a largo plazo.

Resumen

La Inteligencia Artificial está evolucionando a un ritmo exponencial, y cada nueva generación de modelos logra avances que hace poco se consideraban inviables. Aunque estos agentes y los modelos subyacentes aún no son perfectos, la tendencia clara es que seguirán mejorando rápidamente. Las organizaciones que empiecen a probar la IA agéntica hoy pueden aprovechar el valor incremental mientras se preparan para capacidades aún más sofisticadas el día de mañana. Al centrarse en la automatización de tareas, mantener una fuerte supervisión humana y aplicar controles de riesgo sólidos, las empresas pueden obtener beneficios transformadores sin asumir riesgos indebidos. Aquellas que se adelanten no solo obtendrán beneficios compuestos, sino que también desarrollarán la agilidad necesaria para integrar futuros avances sin problemas, mientras que las que duden pueden encontrarse luchando por ponerse al día en un mundo impulsado por la IA.

Ideas clave

- Los modelos de IA resuelven ahora problemas complejos con una precisión mucho mayor que hace unos meses. Las empresas que basan sus decisiones únicamente en los resultados del año pasado corren el riesgo de subestimar el potencial de la IA a corto plazo.

- Retrasar la adopción significa perder valiosos aprendizajes provisionales y ahorros de costes. Con el tiempo, los primeros en adoptarla acumulan optimizaciones de procesos, conjuntos de habilidades y ventajas de datos que resultan difíciles de igualar más adelante.

- En la actualidad, la IA destaca en la automatización de partes discretas y repetibles de trabajos, no de funciones completas. Incluso la automatización parcial -entre el 30% y el 50% de las tareas de gran volumen- puede generar ganancias significativas en eficiencia y productividad.

- Técnicas como los despliegues escalonados, la supervisión continua, las salvaguardas en la toma de decisiones y las revisiones humanas pueden evitar que los errores de la IA causen daños a la reputación o a la normativa, lo que permite una ampliación segura y responsable.

Recomendaciones

- Inicie proyectos de IA agéntica ahora para poder actualizar sin problemas a modelos más avanzados durante la implementación. Esto asegura las inversiones futuras y acelera la diferenciación competitiva.

- Comience con casos de uso de menor riesgo (por ejemplo, tickets de soporte básico) antes de pasar a áreas de alto riesgo. Este enfoque fomenta la aceptación interna, permite mejorar los procesos e identifica los posibles modos de fallo en una fase temprana.

- Posicione a los agentes como «compañeros de trabajo» o asistentes digitales, automatizando determinadas tareas mientras los humanos se encargan de las decisiones complejas. Esto equilibra el ahorro de costes con el mantenimiento del criterio humano necesario para la calidad y la innovación.

- Utilice alertas automatizadas, revisiones humanas y registros sólidos para detectar rápidamente anomalías o «alucinaciones». Establezca juntas o comités de gobernanza para garantizar la alineación permanente con los objetivos empresariales y las normas reglamentarias.

Introducción

Aunque la inversión en IA sigue aumentando, su adopción sigue siendo un reto: el 55% de las organizaciones afirman utilizar la IA en al menos una unidad de negocio, pero muchas luchan por ampliar los proyectos más allá de los proyectos piloto iniciales (Índice de IA de Stanford). (Índice de IA de Stanford) Esta cruda realidad refleja la paradoja a la que se enfrentan los líderes en IA: todo el mundo ve el potencial de la IA, pero pocos lo han hecho realidad a gran escala. Ahora, una nueva ola de IA Agéntica -agentes autónomos impulsados por modelos de razonamiento avanzados- promete acabar con ese estancamiento. Estos agentes de IA pueden resolver problemas complejos y actuar en nuestro nombre. Pero, ¿deberían las empresas lanzarse ahora, dado que los agentes actuales siguen cometiendo errores? La evidencia dice que sí. Las capacidades de la IA están mejorando a un ritmo sin precedentes. Sólo en el último año, el último modelo de razonamiento de IA de OpenAI pasó de resolver el 13% de los problemas matemáticos avanzados al 83%, superando con creces a su predecesor. Y el modelo de nueva generación o3 de OpenAI casi triplicó el rendimiento de o1 en pruebas de razonamiento general tan solo unos meses después, un progreso que habría parecido imposible un año antes.

Esta rápida evolución es más que una historia tecnológica; es un punto de inflexión estratégico para el negocio. Las empresas con visión de futuro se están dando cuenta de que para cuando una iniciativa de IA bien planificada se ponga en marcha, la tecnología subyacente será mucho más capaz. En otras palabras, la IA que se despliegue dentro de 18 meses no será la IA con la que se empiece a construir hoy, sino que será mejor. Potencialmente, órdenes de magnitud mejor. Esto crea un argumento de peso para empezar a invertir en agentes de IA ahora. Las empresas que actúan hoy pueden aprovechar la curva de mejora, mientras que las que esperan a la IA «perfecta» pueden descubrir que han esperado demasiado y se han quedado atrás.

En este artículo exploraremos la rápida evolución de los agentes de IA y explicaremos por qué ser «imperfecto» no significa ser «ineficaz». Construiremos el caso de negocio para adoptar la IA Agéntica pronto, y esbozaremos cómo hacerlo de forma responsable - a través de despliegues por fases que gestionen el riesgo y creen valor paso a paso. Al final, un mensaje debe quedar claro: cuando se trata de desplegar agentes de IA en la empresa, esperar es el movimiento más arriesgado de todos.

La Aceleración de los Agentes de IA

El ritmo de avance de los agentes de IA es vertiginoso. En los últimos 12-18 meses, los investigadores de IA han resuelto problemas que dejaban perplejas a las generaciones anteriores de modelos. Los principales proveedores están inmersos en una carrera armamentística para mejorar el razonamiento y la autonomía de la IA: los nuevos modelos de la «serie o» de OpenAI (optimizados para el razonamiento paso a paso) son un buen ejemplo. El modelo insignia o1, lanzado a finales de 2024, dedicó más tiempo a «pensar» y consiguió resolver tareas complejas con tasas de éxito hasta entonces desconocidas. Su sucesor, OpenAI o3 (presentado unos meses más tarde), dio otro salto cualitativo: obtuvo un 87,5% frente al 32% de su predecesor en una prueba general de resolución de problemas y alcanzó el nivel de Gran Maestro Internacional en retos de codificación. En pocas palabras, la habilidad de un agente de IA para el razonamiento complejo, que era mediocre el verano pasado, pasó a ser de categoría mundial esta primavera. Esta mejora exponencial está redefiniendo lo que pueden hacer los agentes de IA.

Y no se trata solo de OpenAI. DeepMind (de Google) lanzó Gemini 2.0 "Flash", incorporando un proceso de "razonamiento" de múltiples pasos similar para potenciar su capacidad analítica. Una variante experimental incluso descompone los problemas en subpasos para que la IA pueda reflexionar antes de responder, una técnica que Google reconoció abiertamente fue pionera de OpenAI con su modelo o1. Mientras tanto, un actor de código abierto, DeepSeek, lanzó DeepSeek-R1, un modelo agente optimizado para razonamiento que logró igualar el rendimiento de OpenAI o1 en benchmarks clave. Este fue un momento crucial: las capacidades más avanzadas de los agentes de IA ya no están confinadas a los gigantes tecnológicos, sino que se están difundiendo rápidamente en la industria.

Lo más relevante para las empresas es que estos avances benefician directamente las aplicaciones de IA agentiva. Un mejor razonamiento significa que los agentes de IA pueden manejar cadenas de decisiones más complejas sin supervisión humana, ya sea para resolver problemas de solicitudes de TI, aprobar reclamos de seguros o gestionar excepciones en la cadena de suministro. Estamos siendo testigos del nacimiento de "compañeros de trabajo" de IA que pueden realizar tareas de forma autónoma que antes requerían un juicio humano significativo. Las tendencias indican que cada nueva generación de modelos de IA nos acerca a agentes más confiables, conscientes del contexto y capaces de operar con una supervisión mínima. Además, la línea entre un modelo de IA y un agente de IA se está difuminando; para 2025, muchos modelos incorporarán herramientas y toma de decisiones, funcionando esencialmente como trabajadores digitales.

Para los responsables de IA, la conclusión es que las capacidades de la IA agéntica avanzan mucho más rápido que los ciclos tecnológicos típicos de las empresas. Lo que un agente de IA no podría hacer bien en 2024 podría hacerlo sin esfuerzo en 2025. En anteriores cambios tecnológicos, los líderes empresariales y tecnológicos rara vez tuvieron que evaluar y desplegar soluciones tan rápidamente, y desde luego no a la velocidad exponencial de la evolución de la IA. Dada esta aceleración, la evaluación de los agentes de IA basada únicamente en las capacidades del año pasado subestimará lo que ofrecerán en el momento de su implantación. En resumen, debemos evaluar la IA agéntica con una visión extrapolada de su evolución. Las próximas secciones se basarán en esto, analizando por qué es prudente actuar pronto y cómo aprovechar estos agentes de rápida mejora de forma pragmática

Razones Económicas para Invertir Ahora

¿Por qué invertir en agentes de IA ahora, cuando todavía cometen errores? Porque en los negocios, el momento oportuno suele ser la diferencia entre los líderes del mercado y los rezagados. Esperar a que la IA sea «perfecta» es una propuesta perdedora, tanto por el coste de oportunidad del retraso como por las ventajas de una adopción temprana.

En primer lugar, hay que tener en cuenta el plazo de implantación de los proyectos de IA empresarial. Desplegar cualquier solución de IA significativa en una gran empresa no es una tarea de un día para otro: puede llevar meses aprobar presupuestos y formar equipos, y un año o más pilotar e integrar en la producción. Para cuando su sistema de IA agéntica esté totalmente desplegado, la IA de vanguardia de hoy en día habrá madurado y será mucho más capaz. Por ejemplo, si una organización hubiera puesto en marcha una iniciativa de agente de IA a principios de 2024, podría haber empezado con tecnología de nivel GPT-4; a principios de 2025 podría actualizar a los modelos o1 de OpenAI durante la implementación y lanzarla con capacidades muy superiores sin tener que reiniciar el proyecto. Esperar sólo habría significado perder esos beneficios provisionales. En esencia, iniciar un proyecto de IA ahora es una forma de prepararse para el futuro: posiciona a su empresa para capitalizar cada oleada de mejoras a medida que se produzcan.

En segundo lugar, existe una brecha competitiva cada vez mayor entre los pioneros y los rezagados. Las empresas que experimentan pronto no sólo obtienen acceso a una tecnología mejor en el futuro, sino que aprenden a utilizarla, ajustan sus procesos y adquieren conocimientos institucionales. Se trata de activos intangibles que los adoptantes tardíos tienen dificultades para alcanzar. Los pioneros también atraen talento de IA y establecen antes la infraestructura de datos. La recompensa es tangible: los primeros en adoptar la IA ya están superando a sus homólogos. Un análisis reciente demostró que las empresas que adoptan la IA a gran escala con estrategias proactivas registran márgenes de beneficios entre tres y 15 puntos porcentuales superiores a la media del sector. (McKinsey sobre el ROI de la IA). Las empresas que adoptan la IA tardíamente corren el riesgo de sufrir descensos al quedar rezagadas respecto a la curva de eficiencia. Esto ilustra un efecto compuesto: las pequeñas ganancias de automatización de hoy pueden convertirse en una bola de nieve con un gran impacto financiero a lo largo del tiempo, pero solo si se empiezan a acumular esas ganancias.

En tercer lugar, el coste de la inacción está aumentando. Cada trimestre que pasa, más competidores están incorporando la IA a sus operaciones. Casi el 90% de las empresas de la lista Fortune 1000 están aumentando sus inversiones en IA y más del 85% de los ejecutivos creen que la IA es fundamental para mantenerse en cabeza. Si opta por «esperar a ver qué pasa», puede estar cediendo terreno sin darse cuenta. Para cuando los agentes de IA sean infalibles (si es que ese día llega), los procesos empresariales, las expectativas del mercado e incluso las habilidades de la mano de obra a su alrededor habrán evolucionado, favoreciendo a los que integraron la IA antes. La historia lo ha demostrado con tecnologías como la computación en nube o las aplicaciones móviles: cuanto más se espera, más difícil es ponerse al día una vez que la tecnología se convierte en estándar.

Dicho esto, invertir ahora no significa jugarse la empresa y la carrera profesional en una tecnología no probada. Se trata de empezar poco a poco, pero de forma estratégica. El argumento comercial a favor de los agentes de IA debe basarse en el valor incremental y el aprendizaje, no en una gran explosión. Debe identificar los casos de uso en los que incluso una automatización parcial por parte de un agente de IA puede ahorrar tiempo o dinero significativos, enmarcarlo como un piloto con un alcance controlado y destacar cómo esos ahorros se incrementarán cuando se amplíen. Al presentar una historia clara de retorno de la inversión (por ejemplo, «Si un agente gestiona el 30% de las solicitudes de asistencia de nivel 1, ahorraremos X millones de dólares al año»), los responsables de la IA pueden justificar la inversión hoy, al tiempo que señalan la trayectoria de las mejoras tecnológicas como una ventaja que hará que esas cifras sean aún mejores en el momento del lanzamiento.

El mensaje clave: No evalúe la IA Agéntica sólo como existe en este momento, tenga en cuenta hacia dónde se dirige. Los líderes expertos en IA invierten en lo que será, no sólo en lo que es. Apostar pronto por los agentes de IA -con un plan inteligente- es la mejor manera de asegurarse las ventajas del mañana y evitar tener que ponerse al día más adelante.

Automatización Escalable, No Reemplazo de Roles

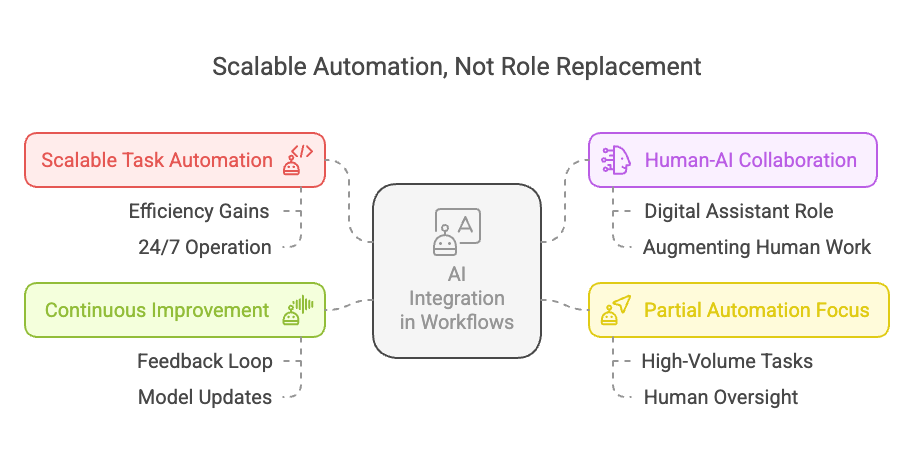

En medio del entusiasmo por los agentes de IA, los líderes deben mantener las expectativas bajo control: en un futuro previsible, incluso la mejor IA tendrá tasas de error en ciertas tareas. Adopta una mentalidad pragmática: busca la automatización escalable de tareas, no la eliminación directa de puestos de trabajo. Esta distinción es clave para ganar apoyo y evitar decepciones.

La IA sobresale en tareas, no en empleos completos. Los estudios muestran que, aunque solo ~5% de las ocupaciones pueden automatizarse de extremo a extremo, la mayoría de los trabajos tienen entre 20% y 50% de actividades automatizables con la tecnología actual. Esto significa que la mayoría de los empleados tendrán algunas tareas que un agente de IA podría realizar mucho más rápido o a mayor escala, y otras que seguirán requiriendo juicio humano, creatividad o empatía. Los líderes en IA deben identificar esas tareas o segmentos de procesos maduros para la automatización. Por ejemplo: un agente podría encargarse de recopilar datos y realizar análisis preliminares en un equipo de analítica, mientras que la interpretación final y las recomendaciones estratégicas provendrían de humanos. Al aislar partes altamente automatizables de los flujos de trabajo, las empresas pueden escalar su eficiencia (ya que el agente opera 24/7, maneja picos de volumen, etc.) sin pretender que la IA pueda hacerlo todo.

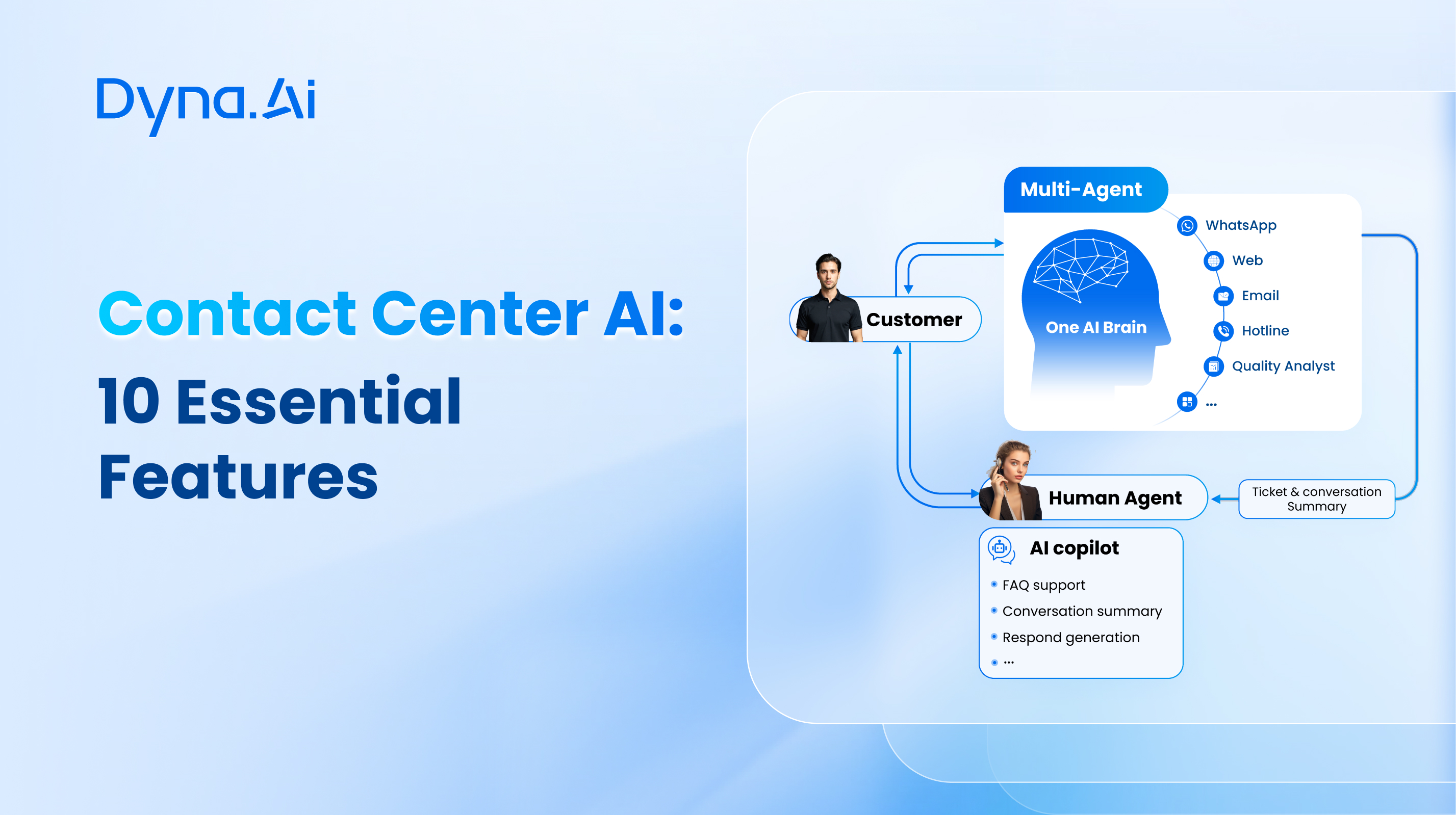

Diseñar para la colaboración humano-IA. En lugar de ver al agente de IA como un reemplazo de una persona, posiciónalo como un asistente digital o copiloto para tus equipos. Este enfoque es poderoso por dos razones: establece límites realistas sobre el rol de la IA y tranquiliza a tu fuerza laboral al demostrar que el objetivo es potenciar su trabajo, no volverlos obsoletos. Por ejemplo, en un departamento de servicio al cliente, podrías implementar un agente de IA para redactar respuestas o resolver consultas simples, mientras que los agentes humanos se enfocan en casos complejos o sensibles. El personal humano ahora tiene más tiempo y energía para dedicar a interacciones de mayor valor, apoyándose en el trabajo automatizado de la IA para tareas más sencillas. Con el tiempo, esto puede mejorar drásticamente la productividad y calidad del servicio: un agente podría efectivamente realizar el trabajo de muchos, pero siempre bajo supervisión humana para las decisiones críticas. Este modelo híbrido aprovecha las fortalezas de ambas partes: la velocidad y escalabilidad de la IA, junto con el juicio y creatividad de los humanos.

Apuntar al '90% de automatización' en lugar del 100%. En términos de ingeniería, los sistemas completamente autónomos suelen toparse con una ley de rendimientos decrecientes (ese último porcentaje de desempeño es el más difícil de lograr). Lo mismo aplica para la IA en procesos empresariales. Intentar automatizar el 100% de un rol requerirá un esfuerzo (y riesgo) exponencialmente mayor que apuntar a una automatización parcial. Y quizás ni siquiera sea necesario: automatizar incluso el 30-50% de tareas de alto volumen puede generar enormes ahorros de costos y tiempo. Al planificar un sistema de seguridad humana o supervisión en los límites de las capacidades de la IA, evitas forzar la tecnología más allá de sus límites confiables. Por ejemplo, permite que la IA procese facturas, pero que los humanos revisen excepciones o una muestra aleatoria de resultados. Esto garantiza que los errores inevitables (que podrían ser del 1-5% de los casos) no afecten la operación. Sí, el agente de IA ocasionalmente podría tropezar con un caso inusual, pero esos quedan cubiertos por diseño. Mientras tanto, te beneficias de la gran mayoría de casos que maneja correctamente.

Prepárate para la mejora continua, no para una solución definitiva. Adoptar la automatización escalable de tareas implica aceptar que los agentes de IA serán un trabajo en constante evolución en tus operaciones. Habrá actualizaciones, nuevas versiones y ajustes necesarios a medida que mejoran (recuerda, la tecnología avanza rápidamente). Establece procesos para capturar casos de error y usarlos para mejorar o reentrenar los modelos. Convierte esto en un ciclo: la IA automatiza a escala, los humanos manejan los casos excepcionales y proporcionan retroalimentación, lo que a su vez ayuda a que la siguiente iteración de la IA pueda manejar más de esos casos. Con el tiempo, la porción de trabajo que la IA puede realizar con fiabilidad crecerá, pero siempre tendrás una red de seguridad para el resto. Este enfoque maximiza el valor mientras minimiza las disrupciones.

Al enfocarse en la automatización escalable a nivel de tareas, las empresas pueden lograr un ROI significativo sin exigirle a la IA una perfección irreal. El éxito radica en la integración, no en la sustitución: incorporar agentes de IA en la fuerza laboral de modo que humanos y máquinas hagan lo que mejor saben hacer. Las compañías que dominen esta sinergia obtendrán una eficiencia tremenda, manteniendo siempre el control sobre la calidad y los resultados.

Gestión de Riesgos en IA Agéntica

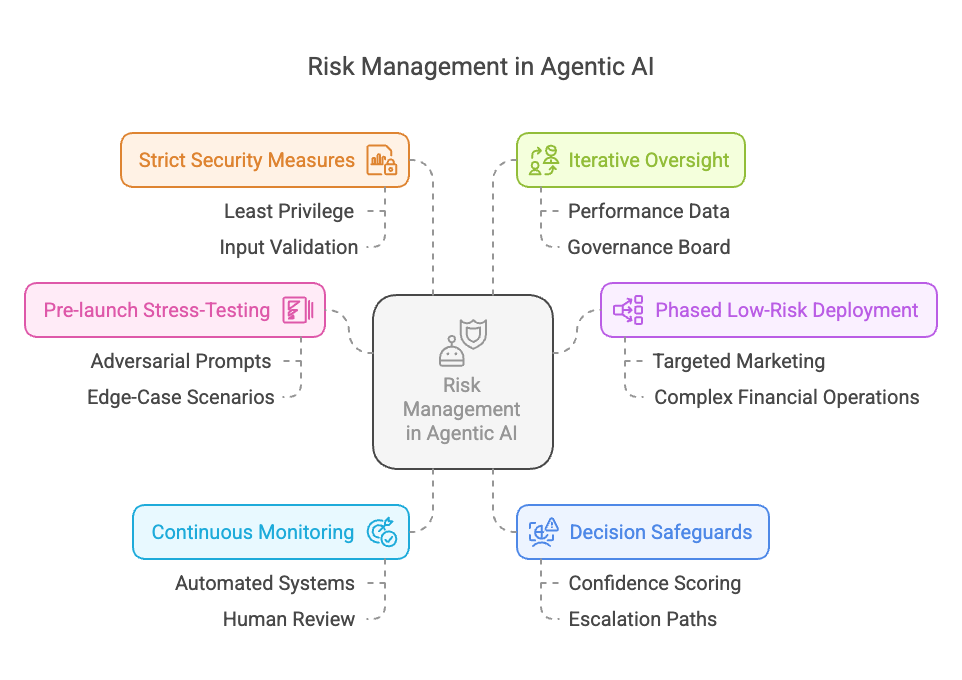

La IA agentiva puede ofrecer beneficios transformadores, pero también introduce riesgos que los líderes en IA deben gestionar activamente. Estos incluyen "alucinaciones", donde la IA genera con confianza información falsa o engañosa; malas decisiones causadas por datos defectuosos u objetivos incorrectos; resultados inconsistentes que erosionan la confianza del usuario; posibles vulnerabilidades de seguridad; y disrupciones en flujos de trabajo críticos. Si no se abordan, estos riesgos pueden dañar a los clientes, socavar el cumplimiento normativo y perjudicar la reputación de la marca. A continuación se presenta un enfoque práctico para identificar, monitorear y mitigar estos riesgos.

Pruebas de Estrés Previas al Lanzamiento

Comienza por realizar pruebas de estrés a tu agente en un entorno seguro. Desafíalo con indicaciones adversarias, datos mal formados y escenarios límite para determinar los posibles modos de fallo, como un razonamiento contradictorio o bucles lógicos. Por ejemplo, si el agente manejará transacciones financieras, observa cómo reacciona ante una volatilidad extrema del mercado o solicitudes ambiguas de los usuarios. Documenta cada defecto y perfecciona el sistema en consecuencia. Este esfuerzo inicial evita sorpresas costosas cuando el IA enfrenta la complejidad del mundo real. Piénsalo como un ejercicio de "equipo rojo": quieres hacer que el IA falle dentro de tu organización para poder fortalecerlo frente a posibles averías futuras.

Implementación Escalonada de Bajo Riesgo

Como siguiente paso, comienza a aplicar la IA agente en escenarios de menor riesgo para limitar el impacto potencial. Por ejemplo, úsala en campañas de marketing dirigidas o en llamadas comerciales rutinarias, donde el hecho de perder una oportunidad de venta o presentar una propuesta imperfecta causa daños mínimos, antes de desplegarla en subscripciones complejas o en operaciones financieras a gran escala que pueden implicar millones de dólares. Al ir escalando gradualmente desde aplicaciones más pequeñas y de bajo riesgo hacia dominios de mayor riesgo, se construye la confianza organizacional en la confiabilidad de la IA y se detectan tempranamente los riesgos ocultos. Este enfoque por fases evita errores catastróficos y asegura que el sistema madure antes de asumir responsabilidades críticas.

Monitoreo continuo

Una vez desplegado, es esencial un monitoreo vigilante. Configure sistemas automatizados para seguir las acciones del agente y detectar anomalías, como picos en los errores, tiempos de respuesta inusuales o cambios drásticos en el comportamiento. Registre todas las salidas y decisiones para la resolución de problemas y las auditorías. Junto con la automatización, mantenga un proceso de revisión con participación humana para tareas sensibles (por ejemplo, aprobaciones financieras, cumplimiento normativo). Las personas pueden detectar problemas más sutiles, como inconsistencias en el tono o violaciones fronterizas de las políticas que los indicadores solos podrían pasar por alto. Al combinar alertas automatizadas y el juicio humano, se asegura de que las salidas de la IA sigan estando alineadas con los objetivos organizacionales y los estándares éticos.

Medidas de protección para las decisiones

Los agentes a veces generan contenido falso o recomendaciones distortas. Para contrarrestar esto, utilice la puntuación de confianza o mecanismos de auto comprobación. Si la confianza de la IA cae por debajo de un umbral, dirija la tarea a la supervisión humana o a un recurso alternativo basado en reglas más sencillo. Por ejemplo, un agente de servicio al cliente podría elevar las solicitudes de reembolso inusuales para una revisión manual. Defina claramente los caminos de escalación: si la IA identifica un escenario de alto riesgo, debe alertar a un supervisor antes de tomar medidas. Estas barreras de protección aseguran que cuando el modelo "visualiza cosas inexistentes" o se vuelve incierto, no siga sin control.

Medidas de seguridad estrictas

La IA autónoma puede actuar con autonomía, así que limite sus privilegios a lo que realmente necesita. Aplique el principio del menor privilegio, ya sea para leer bases de datos o ejecutar comandos del sistema. Implemente la validación de entradas para frustrar los hackeos adversarios y los intentos de inyección. En sectores regulados como el financiero o el sanitario, integre comprobaciones de cumplimiento en el flujo de trabajo de la IA. Por ejemplo, un agente de reclamaciones de seguros podría bloquear decisiones que infrinjan la normativa local. Mantenga registros detallados de las actividades del agente y audítelos periódicamente. Si la IA tiene que manejar datos privados de los usuarios, asegúrese de que cumple normas como GDPR o HIPAA. Al tratar la IA del agente como un sistema de alto riesgo con comprobaciones rigurosas, se reduce la posibilidad de que se produzcan acciones no autorizadas o un uso indebido de los datos.

Supervisión iterativa

La gestión de riesgos es un esfuerzo continuo. Recopile datos de rendimiento -tendencias de errores, quejas de los usuarios, incidentes que estuvieron a punto de producirse- e introdúzcalos en las actualizaciones del modelo o en los ajustes oportunos. Las comprobaciones frecuentes ayudan a detectar la desviación del modelo, cuando la precisión se erosiona con el tiempo. Considere la posibilidad de formar una junta de gobierno o un comité de supervisión de la IA que revise los resultados, los registros y las implicaciones éticas de la IA. Este consejo también puede definir directrices sobre transparencia e imparcialidad, garantizando que la evolución de la IA se mantiene en línea con los valores de la organización. Una buena gobernanza fomenta la confianza entre las partes interesadas, reforzando que la seguridad y la fiabilidad son las principales prioridades.

Combinando estas seis recomendaciones, los líderes de la IA pueden desplegar con confianza la IA agéntica sin exponer a sus organizaciones a riesgos inaceptables. Aunque ningún sistema está exento de riesgos, un enfoque proactivo y metódico para gestionar los modos de fallo de la IA ayuda a aprovechar las ventajas de la IA agéntica al tiempo que protege a los clientes, los equipos empresariales, las infraestructuras tecnológicas e incluso su carrera como líder de IA.

Conclusión

Invertir ahora en inteligencia artificial no es sólo una oportunidad, es una necesidad. A medida que la tecnología evoluciona rápidamente, esperar a que sea «perfecta» sólo garantiza oportunidades perdidas y una subida más pronunciada cuando la adopción sea inevitable. Las empresas que se adelantan adquieren una experiencia inestimable en la puesta a punto de sus estructuras, canalizaciones de datos y flujos de trabajo, creando una ventaja competitiva que los tardíos tendrán dificultades para replicar. Mientras tanto, a medida que la inteligencia artificial modifique los puntos de referencia del sector en cuanto a eficiencia, personalización e innovación, los que se retrasen se verán en apuros para seguir el ritmo.

Sin embargo, el éxito de la adopción requiere un enfoque equilibrado. En lugar de intentar sustituir funciones enteras, las empresas deben centrarse en la automatización de tareas, centrándose en procesos de gran volumen y basados en reglas, en los que incluso una IA «imperfecta» puede aportar beneficios inmediatos. Esta estrategia permite a las empresas integrar la IA de forma eficaz, manteniendo al mismo tiempo la supervisión humana de las decisiones complejas o estratégicas. Establecer bucles de retroalimentación continuos -supervisar el rendimiento de la IA, recopilar datos de errores y perfeccionar la colaboración entre humanos y máquinas- garantiza que, a medida que avanza la tecnología, la organización se mantiene ágil y preparada para evolucionar.

Al mismo tiempo, la gestión proactiva del riesgo es esencial para aprovechar el poder de la IA sin exponer a la organización a riesgos innecesarios. Los despliegues escalonados, las pruebas de estrés exhaustivas y las salvaguardas de decisión claras ayudan a mitigar los errores ocasionales de la IA, como las «alucinaciones» o los errores lógicos. En áreas de alto riesgo, como las aprobaciones financieras o el cumplimiento normativo, mantener un proceso de revisión humano en el bucle proporciona una red de seguridad crítica. Al integrar sólidas estructuras de gobernanza y protocolos de seguridad desde el principio, las empresas pueden ampliar con confianza la adopción de la IA sin poner en peligro su situación legal o su reputación.

En última instancia, las ventajas de la IA agéntica -mayor productividad, mejora de la toma de decisiones y nuevas soluciones creativas- superan con creces sus limitaciones actuales. Las organizaciones que tomen hoy medidas decisivas pero mesuradas estarán bien posicionadas para capitalizar el creciente razonamiento y autonomía de la IA. Las que duden corren el riesgo de quedarse atrás, luchando por adaptarse a medida que la IA pasa de ser una ventaja competitiva a una necesidad operativa.